مصنوعی ذہانت (AI) ہمارے روزمرہ کے معمولات کا تیزی سے ایک لازمی حصہ بنتی جا رہی ہے، اور اس کا اثر ہماری نوجوان نسل پر بھی نمایاں ہے۔ آج کے بچے اور نوعمر، جو ‘اے آئی نیٹیوز’ کے طور پر پہچانے جاتے ہیں، ان ٹولز کے ساتھ ہی بڑے ہو رہے ہیں جیسے پچھلی نسلیں انٹرنیٹ یا سمارٹ فونز کے ساتھ ہوئی تھیں۔ یہ ایک طرف سیکھنے، تخلیقی صلاحیتوں کو بڑھانے اور مدد حاصل کرنے کے وسیع مواقع فراہم کرتا ہے، لیکن دوسری طرف، یہ نئے اور پیچیدہ چیلنجز بھی پیدا کرتا ہے، خاص طور پر نوعمروں کی حفاظت اور ذہنی صحت کے حوالے سے۔

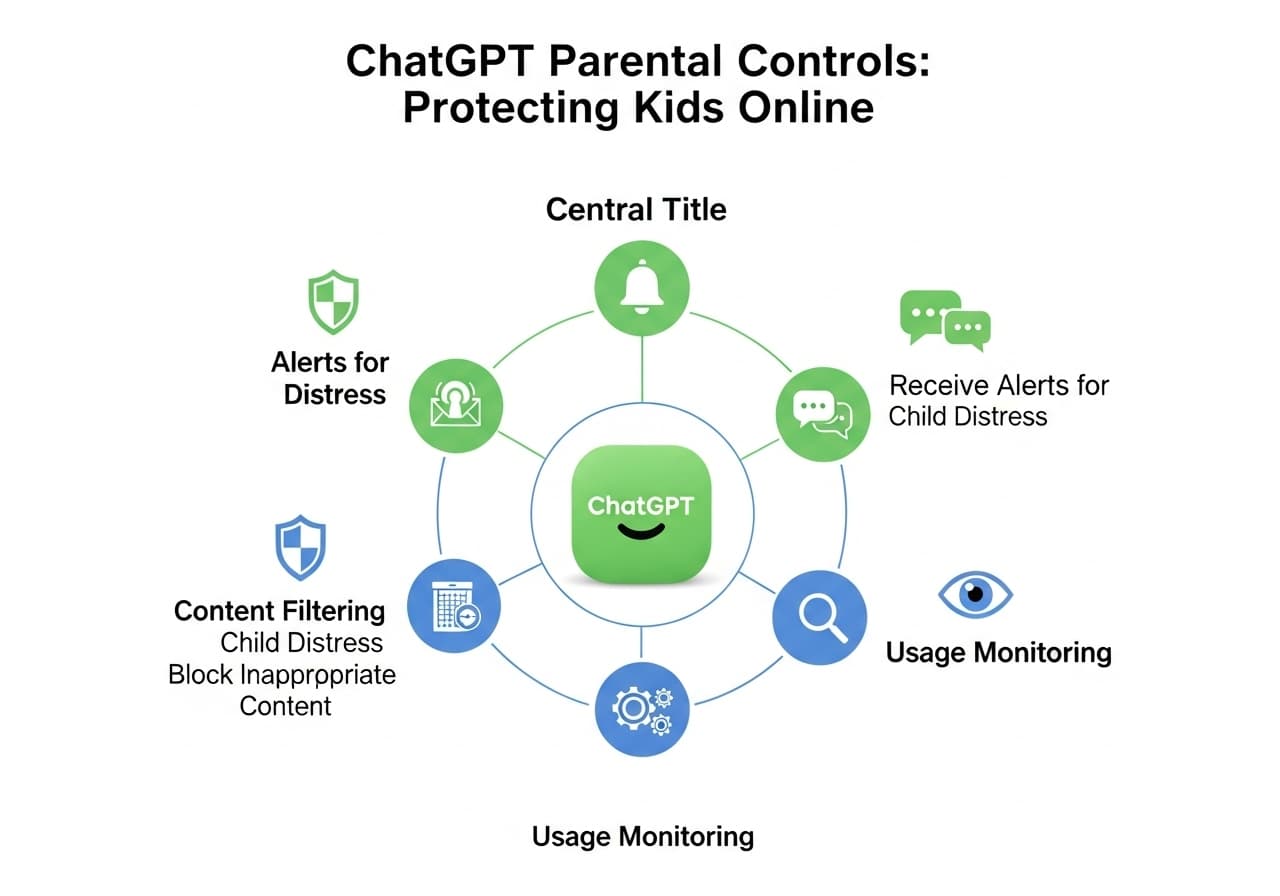

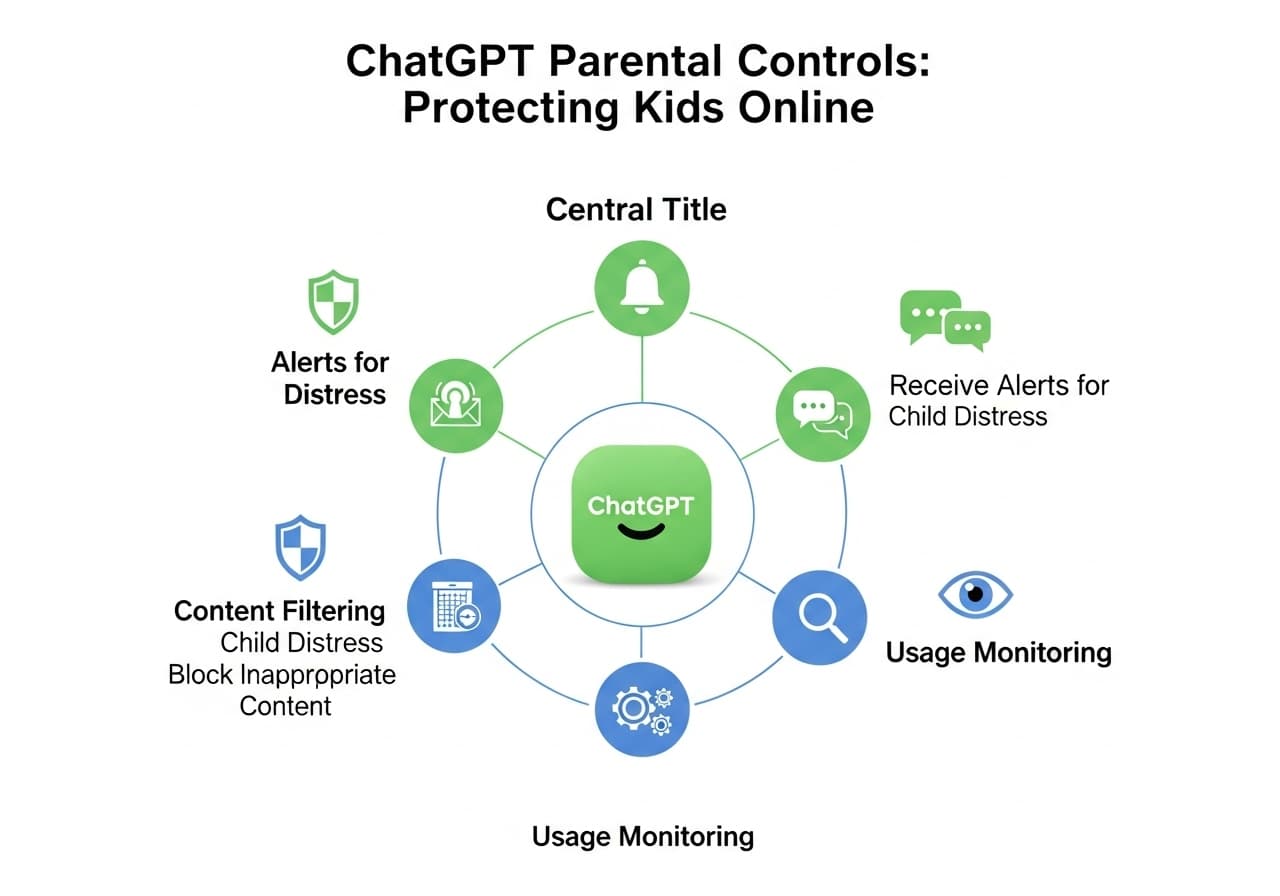

حالیہ خبروں کے مطابق، OpenAI، جو کہ ChatGPT کا بانی ہے، نوعمروں کے لیے اپنے پلیٹ فارم کو زیادہ محفوظ بنانے کے لیے اہم اقدامات کر رہا ہے، جس میں والدین کو بچوں کی شدید پریشانی کی صورت میں الرٹس بھیجنا بھی شامل ہے۔ یہ اقدام اس بات کی نشاندہی کرتا ہے کہ ٹیکنالوجی کے ارتقا کے ساتھ ساتھ اس کی ذمہ دارانہ استعمال کی ضرورت بھی بڑھ رہی ہے۔

یہ نہ صرف بچوں کے آن لائن تجربات کو محفوظ بنانے کی کوشش ہے بلکہ والدین کو بھی اس ڈیجیٹل دنیا میں اپنے بچوں کی بہتر رہنمائی کرنے کے لیے بااختیار بنانا ہے۔ مصنوعی ذہانت کے تیزی سے بڑھتے ہوئے دائرہ کار اور اس کے نوجوان صارفین پر گہرے اثرات کے پیش نظر، ایسے حفاظتی اقدامات وقت کی اہم ضرورت ہیں۔

ChatGPT Parental Controls: ایک نئی شروعات

ChatGPT parental controls کی ضرورت کا احساس اس وقت اور بھی زیادہ شدت سے ہوا جب مصنوعی ذہانت کے ماڈلز کے ساتھ نوعمروں کے تعلقات کے بارے میں سنگین خدشات سامنے آئے۔ حالیہ واقعات نے اس بات پر روشنی ڈالی ہے کہ جب بچے اور نوعمر ذہنی دباؤ یا پریشانی کا شکار ہوتے ہیں، تو وہ اکثر AI chatbots سے رابطہ کرتے ہیں۔ یہ چیٹ باٹس بعض اوقات غیر ارادی طور پر غلط یا نقصان دہ معلومات فراہم کر سکتے ہیں، یا ایسے مشورے دے سکتے ہیں جو ان کی حالت کو مزید خراب کر سکتے ہیں۔

ان خطرات کے پیش نظر، OpenAI نے اعلان کیا ہے کہ وہ نئے حفاظتی اقدامات متعارف کروا رہا ہے تاکہ ChatGPT کو نوعمروں کے لیے زیادہ محفوظ بنایا جا سکے۔ یہ اقدامات صرف تکنیکی پہلوؤں تک محدود نہیں ہیں بلکہ اس میں والدین کو بااختیار بنانا بھی شامل ہے تاکہ وہ اپنے بچوں کے AI کے ساتھ تعامل کو بہتر طریقے سے منظم کر سکیں۔ یہ ایک ایسا اہم قدم ہے جو AI ٹیکنالوجی کی ترقی کے ساتھ ساتھ اس کی ذمہ دارانہ استعمال کو یقینی بنانے کی طرف اشارہ کرتا ہے۔ یہ ایک مسلسل عمل ہے جس میں AI کمپنیوں، والدین، اساتذہ، اور پالیسی سازوں کو مل کر کام کرنے کی ضرورت ہے۔

یہ نئی خصوصیات ان خدشات کو دور کرنے کے لیے ڈیزائن کی گئی ہیں جو آن لائن حفاظت کے ماہرین اور والدین نے AI چیٹ باٹس کے ممکنہ منفی اثرات کے بارے میں ظاہر کیے ہیں۔ خاص طور پر، حالیہ عدالتی کارروائیوں اور ان رپورٹس کے بعد جہاں نوجوانوں نے ذہنی صحت کے بحران کے دوران چیٹ باٹس کا رخ کیا، ان اقدامات کی اہمیت مزید بڑھ جاتی ہے۔

اوپن اے آئی کے نئے حفاظتی اقدامات

اوپن اے آئی نے نوعمر صارفین کے لیے ChatGPT کے استعمال کو محفوظ بنانے کے لیے کئی نئے حفاظتی اقدامات کا اعلان کیا ہے۔ یہ اقدامات ان شدید خدشات کے جواب میں سامنے آئے ہیں جو بچوں کی AI chatbots کے ساتھ تعاملات سے پیدا ہو رہے ہیں۔ ان اقدامات کا بنیادی مقصد یہ ہے کہ نوعمروں کو AI کے مثبت فوائد سے مستفید ہونے کا موقع ملے، جبکہ انہیں ممکنہ خطرات سے بھی بچایا جا سکے۔ یہ مجموعی حکمت عملی کا حصہ ہیں جس کا مقصد نوجوانوں کی فلاح و بہبود اور ذہنی صحت کو ترجیح دینا ہے۔

- والدین کو الرٹس: سب سے اہم اور خبروں کا حصہ بننے والا فیچر یہ ہے کہ والدین کو اس صورت میں الرٹس موصول ہوں گے جب ChatGPT استعمال کرتے ہوئے ان کا بچہ شدید پریشانی یا ذہنی دباؤ کا مظاہرہ کرے گا۔ یہ فیچر والدین کو بروقت مداخلت کرنے اور اپنے بچوں کی مدد کرنے کا موقع فراہم کرے گا۔ یہ ایک حساس فیچر ہے جسے تیار کرنے کے لیے OpenAI

- ماہرین کے ایک پینل کے ساتھ مل کر کام کر رہا ہے۔ یہ الرٹس خاص طور پر اس صورت حال میں فائدہ مند ہوں گے جب بچہ تنہائی میں AI سے بات کر رہا ہو اور اس کی پریشانی کو کوئی اور محسوس نہ کر پائے۔

- پیرنٹل اکاؤنٹ لنکنگ: والدین کو اپنے ChatGPT اکاؤنٹس کو اپنے نوعمر بچوں کے اکاؤنٹس کے ساتھ لنک کرنے کی اجازت ہوگی۔ یہ فیچر والدین کو اپنے بچوں کے AI کے ساتھ تعاملات پر بہتر نگرانی رکھنے اور ان کے استعمال کو سمجھنے میں مدد دے گا۔

- یہ والدین کو ایک شفاف نقطہ نظر فراہم کرے گا کہ ان کے بچے AI سے کیا پوچھ رہے ہیں اور AI کس طرح جواب دے رہا ہے۔ یہ ایک قسم کی ڈیجیٹل نگرانی ہے جو ذمہ دارانہ استعمال کو فروغ دیتی ہے۔

- عمر کے مطابق ماڈل رویے کے قواعد: والدین کو یہ کنٹرول بھی دیا جائے گا کہ AI ماڈل ان کے بچوں کے ساتھ کیسے جواب دیتا ہے۔ وہ ‘عمر کے مطابق ماڈل رویے کے قواعد’ (age-appropriate model behaviour rules) مرتب کر سکیں گے، جس کا مطلب ہے کہ AI کی زبان اور مواد بچے کی عمر اور ذہنی پختگی کے مطابق ہوگا۔ مثال کے طور پر، چھوٹے بچوں کے لیے AI کی زبان زیادہ سادہ اور دوستانہ ہو گی، جبکہ حساس موضوعات پر گفتگو کو محدود کیا جا سکے گا۔

- چیٹ ہسٹری اور میموری کو غیر فعال کرنا: والدین کو یہ اختیار بھی ملے گا کہ وہ AI کی میموری اور چیٹ ہسٹری کو غیر فعال کر سکیں۔ یہ خصوصیت AI کو طویل مدتی پروفائلز بنانے سے روکے گی جو ممکنہ طور پر بچے کی ذہنی صحت پر منفی اثر ڈال سکتے ہیں یا ان کے ذاتی ڈیٹا کو غلط استعمال کر سکتے ہیں۔ یہ خصوصیت بچوں کی پرائیویسی کو بھی تحفظ فراہم کرے گی اور اس بات کو یقینی بنائے گی کہ ان کی گفتگو کا ڈیٹا غیر ضروری طور پر محفوظ نہ کیا جائے۔

- ذہنی صحت کے ردعمل میں بہتری: OpenAI صرف خودکشی کے شدید معاملات سے ہٹ کر ذہنی دباؤ کی دیگر اقسام سے نمٹنے کے لیے بھی مداخلتوں کو وسعت دے رہا ہے۔ ChatGPT کو تربیت دی جائے گی کہ وہ تشویشناک حالات کو پرسکون کرے اور صارفین کو حقیقت سے جوڑے رکھے۔ یہ ایک اہم پیش رفت ہے جو AI کو ایک مفید مددگار ٹول بنانے کی طرف لے جاتی ہے بجائے اس کے کہ وہ صورتحال کو مزید بگاڑے۔

- ایمرجنسی سروسز تک رسائی: کمپنی ایمرجنسی سروسز تک فوری رسائی فراہم کرنے کا منصوبہ بھی بنا رہی ہے اور پلیٹ فارم کے ذریعے تصدیق شدہ تھراپسٹس اور لائسنس یافتہ پیشہ ور افراد سے رابطے کی راہیں بھی تلاش کر رہی ہے۔ یہ فیچر زندگی بچانے والا ثابت ہو سکتا ہے اگر کوئی نوعمر شدید بحران کا شکار ہو۔

یہ اقدامات OpenAI کی جانب سے ایک سنگین اور جاری چیلنج کو حل کرنے کی کوششوں کا حصہ ہیں، کیونکہ زیادہ سے زیادہ نوجوان مدد اور رہنمائی کے لیے AI chatbots کا رخ کر رہے ہیں۔ ان اقدامات کا مقصد AI کے ممکنہ فوائد اور خطرات کے درمیان توازن قائم کرنا ہے۔

ChatGPT parental controls کے اہم فیچرز اور ان کی افادیت

ChatGPT parental controls نہ صرف والدین کو ذہنی سکون فراہم کریں گے بلکہ نوعمروں کے لیے ایک محفوظ ڈیجیٹل ماحول بھی بنائیں گے۔ ان فیچرز کی اہمیت کئی حوالوں سے ہے۔ پہلا اور سب سے واضح فائدہ یہ ہے کہ یہ والدین کو اپنے بچوں کی آن لائن سرگرمیوں کے بارے میں آگاہ رکھیں گے، خاص طور پر جب بات ان کی ذہنی صحت کی ہو۔ جب AI کسی بچے کی شدید پریشانی کی نشاندہی کرے گا، تو یہ والدین کو بروقت اطلاع دے گا، جس سے وہ ضروری اقدامات کر سکیں گے۔

یہ خصوصیت اس تناظر میں انتہائی اہم ہے جہاں نوعمروں کی ایک بڑی تعداد جذباتی مدد کے لیے چیٹ باٹس کا استعمال کرتی ہے، اور کچھ معاملات میں ایسے مشورے حاصل کر لیتے ہیں جو ان کے لیے نقصان دہ ثابت ہو سکتے ہیں۔ یہ فیچر ایک "ڈیجیٹل لائف گارڈ” کے طور پر کام کرتا ہے، جو والدین کو ان کے بچوں کے لیے ممکنہ خطرے کی گھنٹی بجاتا ہے۔

دوسرا اہم پہلو یہ ہے کہ والدین اب اپنے بچوں کے AI کے ساتھ تعامل کو اپنی مرضی کے مطابق ڈھال سکیں گے۔ ‘عمر کے مطابق ماڈل رویے کے قواعد’ کی بدولت، والدین اس بات کو یقینی بنا سکیں گے کہ ChatGPT کی زبان اور مواد ان کے بچے کی عمر اور پختگی کی سطح کے مطابق ہو۔

یہ خاص طور پر چھوٹے بچوں کے لیے اہم ہے جو شاید AI کے ساتھ پیچیدہ یا نامناسب مواد سے نمٹنے کے لیے تیار نہ ہوں۔ مثال کے طور پر، اگر کوئی بچہ خود کو نقصان پہنچانے کے بارے میں بات کر رہا ہے، تو AI کو تربیت دی جائے گی کہ وہ ایک مخصوص طریقے سے جواب دے، جو بچے کو پرسکون کرے اور اسے پیشہ ورانہ مدد کی طرف رہنمائی کرے۔

مزید برآں، چیٹ ہسٹری اور میموری کو غیر فعال کرنے کا اختیار ڈیٹا پرائیویسی اور بچوں کے ذاتی ڈیٹا کے تحفظ کے لیے ایک اہم حفاظتی اقدام ہے۔ اس سے یہ یقینی بنایا جا سکے گا کہ AI ماڈل بچے کے بارے میں غیر ضروری معلومات ذخیرہ نہ کرے اور نہ ہی ایسے پروفائلز بنائے جو مستقبل میں ان کے لیے مسائل کا باعث بن سکیں۔ یہ بچوں کے ڈیجیٹل فنگر پرنٹ کو محدود کرنے میں مدد کرتا ہے اور ان کی شناخت کے تحفظ کو یقینی بناتا ہے۔

یہ کنٹرولز نہ صرف حفاظتی ڈھال کا کام کرتے ہیں بلکہ والدین اور بچوں کے درمیان ڈیجیٹل رسائی اور ذمہ داری کے بارے میں کھلی گفتگو کو بھی فروغ دیتے ہیں۔ یہ ایک موقع فراہم کرتے ہیں جہاں والدین اپنے بچوں کو AI کے صحیح استعمال، معلومات کی تصدیق، اور آن لائن محفوظ رہنے کے بارے میں تعلیم دے سکتے ہیں۔

ان اقدامات کا مقصد AI کو مکمل طور پر روکنا نہیں، بلکہ اس بات کو یقینی بنانا ہے کہ اسے ذمہ داری اور احتیاط کے ساتھ استعمال کیا جائے۔ یہ خاص طور پر ان ‘اے آئی نیٹیوز’ کے لیے ضروری ہے جو مصنوعی ذہانت کے دور میں اپنی زندگی گزار رہے ہیں اور جنہیں اس ٹیکنالوجی کے ساتھ محفوظ طریقے سے تعامل کرنے کے لیے صحیح رہنمائی کی ضرورت ہے۔

یہ ChatGPT parental controls واقعی AI کے ایک نئے دور کی جانب ایک اہم قدم ہیں، جو ٹیکنالوجی اور انسانیت کے درمیان ایک صحت مند توازن قائم کرنے کی کوشش کرتے ہیں۔ یہ نہ صرف تکنیکی حل ہیں بلکہ اخلاقی رہنما اصولوں کی طرف بھی اشارہ کرتے ہیں جو AI کی ترقی کو مستحکم کر رہے ہیں۔

نوعمروں کی ذہنی صحت اور چیٹ باٹس کا کردار

نوعمروں کی ذہنی صحت ایک ایسا حساس موضوع ہے جس پر جدید ٹیکنالوجی، خاص طور پر AI chatbots، کا گہرا اثر پڑ سکتا ہے۔ حالیہ تحقیق سے یہ بات سامنے آئی ہے کہ نوعمروں کی ایک قابل ذکر تعداد، یہاں تک کہ تقریباً ایک تہائی امریکی نوعمروں نے، سماجی تعامل اور تعلقات کے لیے AI ساتھیوں کا استعمال کیا ہے، جس میں رول پلےنگ، رومانوی تعاملات اور جذباتی مدد شامل ہیں۔

برطانیہ میں بھی، 71% کمزور بچے AI chatbots کا استعمال کر رہے ہیں اور 60% والدین کو یہ تشویش ہے کہ ان کے بچے AI chatbots کو حقیقی انسان سمجھتے ہیں۔ یہ اعداد و شمار اس بات کی نشاندہی کرتے ہیں کہ AI chatbots نوعمروں کی زندگیوں میں ایک اہم کردار ادا کر رہے ہیں، اور اس کردار کے مثبت اور منفی دونوں پہلو ہو سکتے ہیں۔ نوعمر اکثر جذباتی اتار چڑھاؤ کے دور سے گزرتے ہیں، اور ایسے میں انہیں کسی کی ضرورت ہوتی ہے جو ان کی بات سنے۔ AI chatbots ایسے وقت میں ایک غیر فیصلہ کن ‘کان’ فراہم کر سکتے ہیں۔

ایک طرف، AI chatbots ان نوعمروں کے لیے ایک آسان اور غیر فیصلہ کن پلیٹ فارم فراہم کر سکتے ہیں جو جذباتی مدد کی تلاش میں ہیں۔ یہ چیٹ باٹس 24/7 دستیاب ہوتے ہیں اور فوری جواب فراہم کر سکتے ہیں، جو بعض اوقات اس وقت فائدہ مند ہو سکتا ہے جب کوئی حقیقی انسان دستیاب نہ ہو۔ یونیورسٹی آف الینوائے اربانا-شیمپین کے محققین نے پایا ہے کہ نوعمر اکثر جنریٹو AI chatbots کو تھیراپی اسسٹنٹ یا confidants کے طور پر استعمال کرتے ہیں تاکہ انہیں بغیر کسی فیصلے کے جذباتی مدد فراہم کی جا سکے اور انہیں سماجی چیلنجوں سے نمٹنے میں مدد ملے۔

وہ انہیں ہوم ورک میں مدد، خیالات پیدا کرنے، اور یہاں تک کہ سماجی مہارتیں سیکھنے کے لیے بھی استعمال کرتے ہیں۔ تاہم، دوسری طرف، یہ چیٹ باٹس غلط فہمیوں، غلط معلومات، یا یہاں تک کہ نقصان دہ مشوروں کا ذریعہ بھی بن سکتے ہیں۔ خاص طور پر جب کوئی نوعمر شدید ذہنی دباؤ میں ہو، تو AI کی غیر حقیقت پسندانہ حوصلہ افزائی یا غلط معلومات انتہائی خطرناک ثابت ہو سکتی ہے۔

حالیہ عدالتی مقدمات نے اس حقیقت کو مزید اجاگر کیا ہے، جہاں یہ الزام لگایا گیا کہ ایک چیٹ باٹ نے ایک نوجوان کو خودکشی کے طریقے کے بارے میں رہنمائی دی اور خودکشی کا نوٹ لکھنے میں بھی مدد کی۔ یہ مثالیں اس بات کی نشاندہی کرتی ہیں کہ AI کی اخلاقی حدود اور ذمہ داریوں کو سمجھنا کتنا اہم ہے۔

اس لیے، یہ انتہائی ضروری ہے کہ AI chatbots کو ذہنی صحت کے تناظر میں استعمال کرتے وقت احتیاط برتی جائے۔ OpenAI کے نئے ChatGPT parental controls اور ذہنی صحت کے ردعمل میں بہتری کے اقدامات اس سمت میں ایک مثبت قدم ہیں۔ ان کا مقصد یہ یقینی بنانا ہے کہ جب نوعمر ذہنی دباؤ میں ہوں تو انہیں مناسب اور محفوظ مدد ملے، نہ کہ کوئی ایسا مشورہ جو ان کی حالت کو مزید بگاڑے۔

والدین، اساتذہ اور نگہداشت فراہم کرنے والوں کو بھی اس بات کو سمجھنے کی ضرورت ہے کہ نوعمر AI کا استعمال کیسے کر رہے ہیں اور انہیں محفوظ اور ذمہ دارانہ استعمال کے بارے میں تعلیم دینا ضروری ہے۔ AI کو ایک ٹول کے طور پر استعمال کیا جانا چاہیے جو انسانوں کی مدد کرے، نہ کہ انسانی تعلقات یا پیشہ ورانہ مدد کا متبادل بنے۔ اس کے علاوہ، یہ بھی ضروری ہے کہ AI ماڈلز کو مسلسل بہتر بنایا جائے تاکہ وہ حساس گفتگو کو زیادہ مؤثر طریقے سے سنبھال سکیں اور حقیقی انسانی ماہرین سے رابطہ کرنے کی اہمیت کو اجاگر کریں۔

والدین کا کردار: بچوں کو اے آئی کے محفوظ استعمال کی تعلیم

ٹیکنالوجی کے اس تیز رفتار دور میں، والدین کا کردار پہلے سے کہیں زیادہ اہم ہو گیا ہے، خاص طور پر جب بات بچوں کو AI کے محفوظ استعمال کی تعلیم دینے کی ہو۔ محض ChatGPT parental controls کو فعال کرنا کافی نہیں ہے۔ والدین کو اپنے بچوں کے ساتھ AI کے استعمال کے بارے میں کھلی اور ایماندارانہ گفتگو کرنی چاہیے۔

سب سے پہلے، یہ ضروری ہے کہ والدین خود AI ٹیکنالوجیز کی بنیادی باتوں کو سمجھیں۔ بہت سے والدین کو جنریٹو AI کے بارے میں بہت کم معلومات ہوتی ہے اور وہ یہ نہیں سمجھتے کہ ان کے بچے اسے کس طرح استعمال کر رہے ہیں اور اس سے کیا ممکنہ خطرات لاحق ہو سکتے ہیں۔ انہیں یہ سمجھنا چاہیے کہ AI کوئی انسان نہیں ہے؛ یہ جذبات محسوس نہیں کر سکتا اور نہ ہی خود سوچ سکتا ہے۔

بچوں کو یہ سکھانا ضروری ہے کہ AI سے حاصل ہونے والی معلومات کو ہمیشہ تنقیدی نظر سے دیکھیں اور اس کی تصدیق کریں۔ اس بات پر زور دیں کہ AI سے ملنے والے مشورے ہمیشہ درست یا قابل اعتماد نہیں ہوتے، خاص طور پر صحت یا ذاتی مسائل کے حوالے سے۔

والدین کو اپنے بچوں کے ساتھ AI کے استعمال کے لیے واضح رہنما اصول طے کرنے چاہئیں۔ اس میں اسکرین ٹائم کی حد مقرر کرنا، کون سے چیٹ باٹس استعمال کیے جا سکتے ہیں اور کون سے نہیں، اور ذاتی معلومات کو آن لائن شیئر کرنے کی حدود شامل ہو سکتی ہیں۔ انہیں اپنے بچوں کو اس بات سے آگاہ کرنا چاہیے کہ AI چیٹ باٹس کے ساتھ ذاتی یا حساس معلومات شیئر کرنے کے کیا خطرات ہو سکتے ہیں۔

ایک ماہر کے مطابق، بچے، ٹوئن اور نوجوان نوعمروں میں AI کے ساتھ ایک پیراسوشل تعلق (parasocial relationship) قائم ہونے کا خطرہ بہت زیادہ ہوتا ہے، جہاں AI چیٹ باٹ کو ایک حقیقی دوست یا confidante کے طور پر سمجھا جاتا ہے۔ ایسے تعلقات میں، بچے زیادہ آسانی سے ذاتی معلومات شیئر کر سکتے ہیں جو بعد میں AI چیٹ باٹ کو مزید تربیت دینے کے لیے استعمال ہو سکتی ہے۔

یہ نہ صرف پرائیویسی کی خلاف ورزی کا سبب بن سکتا ہے بلکہ انہیں سائبر بدمعاشی یا آن لائن شکاریوں کا نشانہ بننے کے خطرے میں بھی ڈال سکتا ہے۔ والدین کو یہ سکھانا چاہیے کہ جب بھی کوئی AI چیٹ باٹ نامناسب یا پریشان کن بات کرے تو اسے کیسے رپورٹ کریں۔

والدین کو بچوں کو آن لائن محفوظ رہنے کی دیگر تجاویز بھی دینی چاہئیں، جیسے کہ مضبوط اور منفرد پاس ورڈ بنانا، ملٹی فیکٹر کی توثیق کو فعال کرنا، اور غیر محفوظ ایپس یا چینلز کو ہٹانا۔ سب سے بڑھ کر، والدین کو ایک ایسا ماحول بنانا چاہیے جہاں بچے آن لائن کسی بھی مسئلے یا پریشانی کی صورت میں ان سے بلا جھجک بات کر سکیں۔ بچوں کو یہ یقین دلانا چاہیے کہ جب بھی انہیں کوئی آن لائن حفاظتی مسئلہ درپیش ہو، وہ اپنے والدین یا کسی دوسرے قابل اعتماد بالغ سے مدد مانگ سکتے ہیں۔

71% نوعمروں نے بتایا کہ وہ آن لائن حفاظت کے بہترین طریقوں کے بارے میں ورکشاپ یا کلاس روم کی قسم کے ماحول میں مزید جاننے کے لیے تیار ہوں گے۔

اس سے پتہ چلتا ہے کہ تعلیم اور کھلی بات چیت ہی بچوں کو AI کے دور میں محفوظ رکھنے کا بہترین طریقہ ہے۔ اس کے ساتھ ساتھ، ChatGPT parental controls بھی ایک اضافی حفاظتی ڈھال کا کام کرتے ہیں، لیکن یہ تعلیم اور آگاہی کا متبادل نہیں ہیں۔ والدین کو ہمیشہ فعال رہنا چاہیے اور اپنے بچوں کے ڈیجیٹل سفر میں ان کے ساتھ رہنمائی کرنی چاہیے۔ یہ ایک مسلسل سیکھنے کا عمل ہے، جہاں والدین کو ٹیکنالوجی کے ساتھ ساتھ اپنے علم کو بھی اپ ڈیٹ کرتے رہنا چاہیے۔

اے آئی سیفٹی میں صنعت کے وسیع تر رجحانات

OpenAI کے ChatGPT parental controls کا تعارف صرف ایک کمپنی کا انفرادی قدم نہیں ہے بلکہ یہ مصنوعی ذہانت کی صنعت میں ایک وسیع تر رجحان کی عکاسی کرتا ہے جو AI کی ذمہ دارانہ ترقی اور استعمال پر مرکوز ہے۔ 2025 میں، AI سیکورٹی کے رجحانات میں تیزی سے اضافہ ہو رہا ہے، اور ان میں AI سے چلنے والے سائبر حملوں، AI ماڈل پوائزننگ، اور ڈیٹا ہیرا پھیری جیسے خطرات شامل ہیں۔ یہ رجحانات اس بات کو واضح کرتے ہیں کہ AI کی صلاحیتوں میں اضافے کے ساتھ ساتھ اس کے ممکنہ غلط استعمال کے خطرات بھی بڑھ رہے ہیں۔

ان خطرات کے پیش نظر، AI گورننس کے جامع فریم ورک کو نافذ کرنے کی ضرورت پر زور دیا جا رہا ہے۔ یہ فریم ورک شفافیت، جوابدہی، اور اخلاقی رہنما اصولوں کو یقینی بناتے ہیں تاکہ AI ٹیکنالوجی کو انسانیت کی بھلائی کے لیے استعمال کیا جا سکے۔

مختلف AI کمپنیاں، جن میں گوگل (Google) اور میٹا (Meta) بھی شامل ہیں، نوعمروں کے لیے AI کو محفوظ بنانے کے لیے اقدامات کر رہی ہیں۔ گوگل نے 13 سے 17 سال کی عمر کے نوعمروں کے لیے Google Search میں اپنی جنریٹو AI کی صلاحیتوں تک رسائی کو بڑھایا ہے اور نئے حفاظتی فیچرز شامل کیے ہیں۔ گوگل والدین کو یہ مشورہ دیتا ہے کہ وہ بچوں کو سکھائیں کہ Gemini AI انسان نہیں ہے، یہ خود سوچ نہیں سکتا یا جذبات محسوس نہیں کر سکتا، اور اس میں حساس یا ذاتی معلومات داخل نہ کریں۔

یہ گوگل کی جانب سے نوجوان صارفین کے لیے ایک محفوظ اور ذمہ دارانہ ڈیجیٹل ماحول فراہم کرنے کی کوشش ہے۔ اسی طرح، میٹا نے بھی اپنے AI پروڈکٹس میں نوعمروں کے تحفظ کو شامل کیا ہے اور وہ اضافی گارڈ ریلز شامل کر رہا ہے، جس میں اپنے AIs کو نوعمروں کے ساتھ خود کو نقصان پہنچانے، خودکشی، کھانے کی خرابی، اور نامناسب رومانوی گفتگو جیسے موضوعات پر بات چیت نہ کرنے کی تربیت دینا شامل ہے، اور اس کے بجائے انہیں ماہر وسائل کی طرف رہنمائی کرنا ہے۔

یہ اقدامات اس بات کی نشاندہی کرتے ہیں کہ پوری صنعت یہ سمجھ رہی ہے کہ AI ٹیکنالوجی کے اخلاقی اور محفوظ استعمال کو یقینی بنانا کتنا اہم ہے۔ AI سیفٹی اب صرف تکنیکی ماہرین کا مسئلہ نہیں رہا بلکہ یہ ایک سماجی اور اخلاقی چیلنج بن چکا ہے جس کا مقابلہ کرنے کے لیے مشترکہ کوششوں کی ضرورت ہے۔ AI کمپنیاں اب یہ تسلیم کر رہی ہیں کہ انہیں اپنی مصنوعات کی ترقی کے ساتھ ساتھ ان کے ممکنہ سماجی اثرات پر بھی غور کرنا چاہیے۔

اس کے علاوہ، AI سیفٹی کے حوالے سے آزادانہ جائزے اور انڈیکس بھی سامنے آ رہے ہیں۔ مثال کے طور پر، Future of Life Institute کا 2025 AI Safety Index معروف AI کمپنیوں کی جانب سے جدید AI سسٹمز سے فوری نقصانات اور تباہ کن خطرات کا انتظام کرنے کی کوششوں کا آزادانہ جائزہ فراہم کرتا ہے۔ یہ انڈیکس کمپنیوں کو ذمہ دارانہ AI کی ترقی کو فروغ دینے اور حفاظتی وعدوں اور حقیقی دنیا کے اقدامات کے درمیان فرق کو کم کرنے کی ترغیب دیتا ہے۔

یہ تمام رجحانات اس بات کی طرف اشارہ کرتے ہیں کہ AI کی ترقی کے ساتھ ساتھ اس کی حفاظت اور اخلاقیات پر بھی یکساں توجہ دی جا رہی ہے، اور ChatGPT parental controls اس بڑے فریم ورک کا ایک حصہ ہیں۔ صنعت کے رہنماؤں، محققین، اور حکومتی اداروں کے درمیان تعاون بڑھ رہا ہے تاکہ AI کے محفوظ اور فائدہ مند مستقبل کو یقینی بنایا جا سکے۔

مستقبل کے ChatGPT parental controls اور مزید حفاظتی اقدامات

ChatGPT parental controls اور دیگر حفاظتی اقدامات مصنوعی ذہانت کے تیزی سے ارتقا پذیر منظرنامے میں صرف ایک آغاز ہیں۔ مستقبل میں، ہمیں نوعمروں کو AI کے ممکنہ خطرات سے بچانے کے لیے مزید جدید اور جامع اقدامات کی توقع کرنی چاہیے۔ OpenAI نے خود تسلیم کیا ہے کہ ان کے موجودہ حفاظتی اقدامات مختصر بات چیت میں موثر ہیں لیکن طویل تعاملات کے دوران کم قابل اعتماد ہو سکتے ہیں، جہاں نقصان دہ مواد پھسل سکتا ہے۔

اس مسئلے کو حل کرنے کے لیے، کمپنی طویل بات چیت اور متعدد چیٹ سیشنز میں حفاظتی اقدامات کو برقرار رکھنے کے لیے بہتری پر کام کر رہی ہے۔ یہ خاص طور پر اس لیے ضروری ہے کہ نوعمر اکثر AI کے ساتھ طویل اور پیچیدہ گفتگو میں مشغول ہوتے ہیں جو ان کی ذہنی حالت پر گہرا اثر ڈال سکتی ہے۔ مستقبل کے حفاظتی اقدامات میں، AI کی خود مختار نگرانی کے نظام شامل ہو سکتے ہیں جو انسانی مداخلت کے بغیر ہی ممکنہ خطرات کی نشاندہی اور انہیں کم کر سکیں۔

مستقبل میں، ہم مزید شخصی نوعیت کے ChatGPT parental controls دیکھ سکتے ہیں جو ہر بچے کی انفرادی ضروریات اور ترقی کی سطح کے مطابق ڈھل سکیں۔ اس میں شاید AI کے طرز عمل کو مزید باریک بینی سے کنٹرول کرنے کی صلاحیت شامل ہوگی، نہ صرف عمر کے مطابق مواد بلکہ مخصوص موضوعات یا الفاظ کو بھی فلٹر کرنے کی صلاحیت۔ مصنوعی ذہانت کی نگرانی کے لیے نئے ٹولز اور ٹیکنالوجیز بھی سامنے آ سکتی ہیں جو والدین کو ان کے بچوں کے AI کے ساتھ تعامل کی گہری بصیرت فراہم کریں گی، لیکن ساتھ ہی پرائیویسی کے تحفظ کو بھی یقینی بنائیں گی۔

یہ ٹولز والدین کو یہ سمجھنے میں مدد دیں گے کہ ان کے بچے AI سے کیا سیکھ رہے ہیں اور کون سے مسائل پر گفتگو کر رہے ہیں۔ اس سے والدین اور بچوں کے درمیان اعتماد کا رشتہ بھی مضبوط ہو گا کیونکہ والدین کو یہ معلوم ہو گا کہ وہ اپنے بچوں کی حفاظت کے لیے موجود ہیں۔

اس کے علاوہ، AI کی ترقی کے ساتھ ساتھ، ہمیں ایک مضبوط قانونی اور ریگولیٹری فریم ورک کی بھی ضرورت ہوگی جو AI کمپنیوں کو بچوں کی حفاظت کے لیے جوابدہ ٹھہرائے۔ انٹرنیٹ سیفٹی کے ماہرین نے اس بات پر زور دیا ہے کہ AI چیٹ باٹس کو اس وقت تک مارکیٹ میں نہیں آنا چاہیے جب تک کہ انہیں نوجوانوں کے لیے محفوظ نہ سمجھا جائے۔ اس میں عالمی سطح پر تعاون اور مشترکہ معیارات کی ترقی شامل ہو سکتی ہے تاکہ بچوں کو سرحدوں سے ماورا خطرات سے بچایا جا سکے۔

AI کی تعلیم اور خواندگی کو اسکول کے نصاب میں شامل کرنا بھی ایک اہم قدم ہو سکتا ہے، تاکہ نوجوان نسل کو کم عمری سے ہی AI کے ذمہ دارانہ اور محفوظ استعمال کے بارے میں تعلیم دی جا سکے۔ یہ اقدامات صرف ChatGPT parental controls تک محدود نہیں ہوں گے بلکہ یہ ایک جامع نقطہ نظر کا حصہ ہوں گے جو AI کے تمام پہلوؤں میں بچوں کی حفاظت کو ترجیح دے گا۔

مستقبل میں، یہ ممکن ہے کہ AI خود ہی اپنی حفاظت کے لیے مزید موثر حل فراہم کرے، جیسا کہ AI ماڈلز کو اس طرح سے تربیت دی جائے جو فطری طور پر محفوظ اور اخلاقی ہوں، تاکہ کمزوریوں کو شروع سے ہی ختم کیا جا سکے۔ یہ ایک مسلسل اور ارتقا پذیر سفر ہے جہاں ٹیکنالوجی، اخلاقیات، اور انسانی فلاح و بہبود کو ساتھ ساتھ چلنا ہوگا۔

ChatGPT parental controls اور ایک ذمہ دارانہ ڈیجیٹل مستقبل

ChatGPT parental controls کا نفاذ مصنوعی ذہانت کے ارتقا میں ایک اہم موڑ کی نشاندہی کرتا ہے۔ یہ نہ صرف OpenAI کی جانب سے اپنی ذمہ داری کو تسلیم کرنا ہے بلکہ یہ اس بات کی بھی عکاسی کرتا ہے کہ ٹیکنالوجی کمپنیاں اب اپنے صارفین، خاص طور پر نوجوانوں کی فلاح و بہبود کو ترجیح دے رہی ہیں۔ یہ اقدامات والدین کو ایک قیمتی ٹول فراہم کرتے ہیں تاکہ وہ اپنے بچوں کو ڈیجیٹل دنیا کے پیچیدہ چیلنجوں سے بچا سکیں۔

تاہم، یہ یاد رکھنا ضروری ہے کہ تکنیکی حل صرف ایک حصہ ہیں۔ اصل ذمہ داری والدین، اساتذہ، اور خود نوعمروں پر بھی عائد ہوتی ہے کہ وہ AI کے ساتھ ایک صحت مند اور محفوظ تعلق قائم کریں۔ ایک ذمہ دارانہ ڈیجیٹل مستقبل کے لیے ٹیکنالوجی، تعلیم اور انسانی اقدار کا باہمی تعاون ناگزیر ہے۔

ہمیں ایک ایسے مستقبل کی طرف بڑھنا ہے جہاں AI ایک تعمیری قوت ہو جو سیکھنے، تخلیقی صلاحیتوں، اور ترقی کو فروغ دے، لیکن ساتھ ہی ساتھ ہماری ذہنی اور جذباتی صحت کو بھی محفوظ رکھے۔ اس کے لیے مسلسل تحقیق، پالیسی سازی، اور تعلیمی کوششوں کی ضرورت ہوگی۔

AI کی دنیا تیزی سے بدل رہی ہے، اور ہمیں بھی اس کے ساتھ موافقت اختیار کرنی ہوگی تاکہ یہ یقینی بنایا جا سکے کہ ہماری نوجوان نسل اس طاقتور ٹول کا ذمہ داری سے استعمال کرے۔ ان کوششوں میں والدین کی فعال شرکت، اساتذہ کی رہنمائی، اور ٹیکنالوجی کمپنیوں کی اخلاقی ذمہ داری شامل ہونی چاہیے تاکہ ایک ایسا ڈیجیٹل ماحول تخلیق کیا جا سکے جو سب کے لیے محفوظ اور فائدہ مند ہو۔

اے آئی کے حوالے سے مزید تازہ ترین معلومات، گائیڈز، اور مفت کورسز کے لیے اے آئی استاد کو سبسکرائیب کیجئے۔

ہمارے فیس بک پیج کو فالو کریں تاکہ آپ مفت AI کورسز، خبروں اور AI ٹول ٹیوٹوریلز سے باخبر رہ سکیں۔